BTC/HKD+3.39%

BTC/HKD+3.39% ETH/HKD+6.22%

ETH/HKD+6.22% LTC/HKD+4.73%

LTC/HKD+4.73% ADA/HKD+6.97%

ADA/HKD+6.97% SOL/HKD+9.3%

SOL/HKD+9.3% XRP/HKD+8.24%

XRP/HKD+8.24%來源:新智元編輯:Aeneas好困

快速定制模型的LLM引擎Lamini來了,開發者狂喜!

ChatGPT雖好,但始終有門檻。通常,只有擁有AI博士學位的大型機器學習團隊,才能這樣訓練一個模型。

為了把這個門檻打下來,團隊構建了Lamini引擎,從此,每個開發者都能夠擁有從GPT-3訓練ChatGPT的超能力!

劃重點:可以商用!可以商用!可以商用!

項目地址:https://github.com/lamini-ai/lamini/

Lamini的開發團隊表示,你需要的只是幾行代碼,就可以用托管數據生成器倆訓練自己的LLM,包括權重和其他所有的內容。

此外,你也可以使用開源的LLM,用Lamini庫對生成的數據進行微調。以及訪問完整的LLM訓練模塊,使用從LoRa等速度優化,到虛擬私有云(VPC)部署等企業功能。

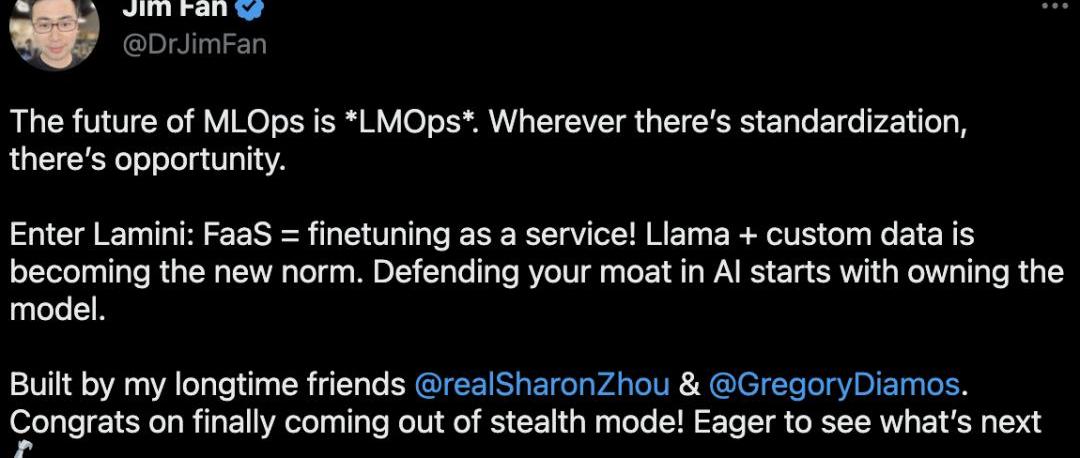

對此,英偉達科學家JimFan表示,LLaMa+自定義數據正在成為新的范式,而Lamini的推出也帶了一種全新的模式——FaaS,微調即服務。

AI Meta Club推出AI生成圖片功能,并將五月底首發治理代幣$AMC:據官方Twitter消息,AI Meta Club(AMC)今日推出了Text 2 Image的功能,用戶可以在社群通過“draw”命令AI來作畫,這是首個達成AI生成圖片的Web3-native項目。此外,AI Meta Club還將推出更多AIGC的工具。該項目之前因利用AI學習馬斯克前女友Grimes的聲音,并在Twitter發布Grimes的說唱而知名。AI Meta Club將于五月底首發治理代幣$AMC。[2023/5/16 15:05:57]

MLOps的未來是「LMOps」。哪里有標準化,哪里就有機會。

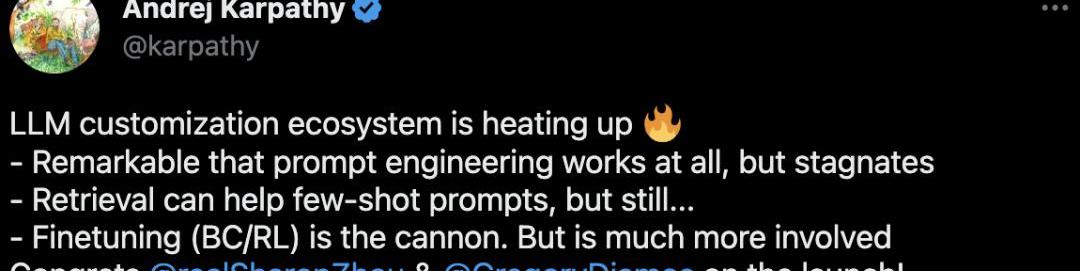

OpenAI科學家,前特斯拉人工智能總監AndrejKarpathy也表示,LLM定制化的生態正在愈發火爆。

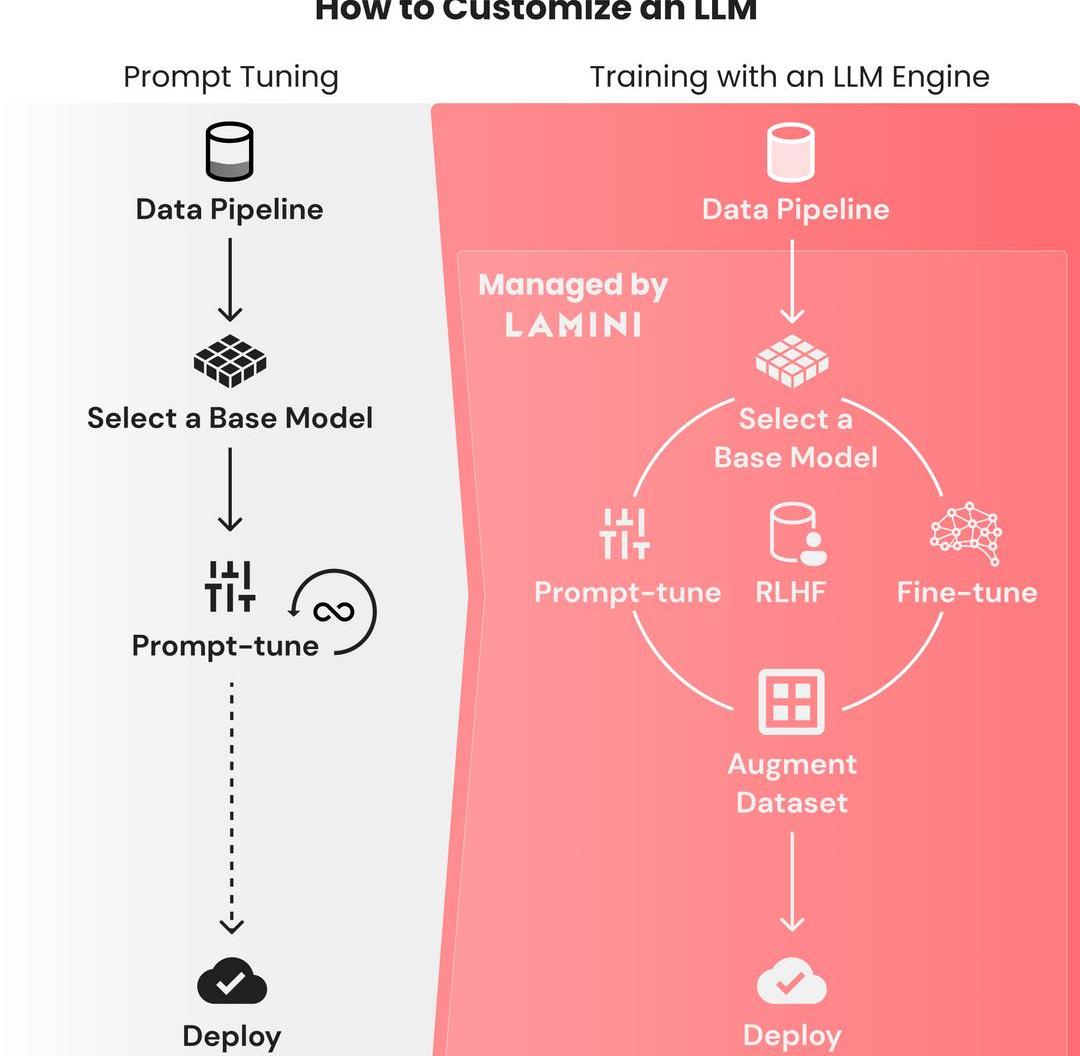

訓LLM就像prompt-tuning一樣簡單

寫一個prompt如此容易,但想要從基礎模型訓練出一個大語言模型,卻是如此困難。

因為需要花費大量時間,來找出微調模型失敗的原因,所以對數據集微調的迭代周期都是以月為單位的。

與之相反,微調prompt的迭代,只需要幾秒鐘,并且在幾個小時內,性能都能保持穩定。

這個過程只需要把有限數量的數據整合到prompt中就可以了,并不需要動輒幾TB的數據。

法庭文件顯示FTX欠客戶16億美元的比特幣,但目前只有100萬美元:金色財經報道,新的法庭文件顯示FTX欠客戶16億美元的比特幣,但目前只有100萬美元。只占他們應該擁有的0.06%。[2023/3/4 12:41:31]

ChatGPT的誕生十分艱難,OpenAI的團隊花了幾個月的時間,在基礎的GPT-3模型上微調,并進行RLHF。這個門檻極高,只有大型的ML團隊才能完成這種訓練。

有500強企業的技術負責人這樣抱怨過:「我們團隊的10名機器學習工程師用了OpenAI的微調API,結果我們的模型反而變得更差了,怎么辦啊。」

「我真的不知道該怎么充分利用數據,我已經用盡了所有從在線教程中能學到的prompt魔法了。」

這,就是研究者構建Lamini的原因:讓每個開發者可以直接從GPT-3訓練ChatGPT。

任意LLM,秒變ChatGPT!

Lamini是一個LLM引擎,可以讓不僅僅是機器學習專家的任何開發人員,都能在大型數據集中,把高性能的LLM訓練得像ChatGPT一樣好。

這個過程,只需要Laimini庫的幾行代碼即可。

值得注意的是,這個庫中的優化遠遠超出了現在開發者可以使用的范圍,從更具挑戰性的優化到更簡單的優化。

比如,你想從不同的角度生成一個廣告文案。

首先,從llama模塊導入LLM引擎:

fromllamaimportLLMllm=LLM(name="marketing")

接下來,需要定義輸入和輸出類型。注意,這里一定要包括上下文,因為可以有助于LLM在自然語言中進行理解。

美SEC委員Hester Peirce:在打擊Kraken質押業務之前,SEC沒有咨詢行業:金色財經報道,美國SEC委員Hester Peirce周五表示,在本周對“質押即服務”發起未注冊證券打擊之前,SEC并沒有試圖與加密行業進行磋商。美國最高投資監管機構對Kraken的訴訟是數字資產領域執法監管的最新例子。

Peirce說,我們沒有試圖與業內人士坐下來討論質押,這是加密貨幣持有者將他們的代幣委托給驗證者以獲得加密獎勵的過程。美國SEC很早就知道質押,現在打擊的決定是“武斷的”,就像它首先針對Kraken的質押業務一樣。

Peirce對針對Kraken的限制性條款尤其不滿。她稱,該公司已發誓永遠不會為美國客戶重新啟動質押業務,這意味著在SEC看來,即使它愿意,也無法通過光明正大的程序進行操作。(CoinDesk)[2023/2/11 11:59:53]

fromllamaimportType,ContextclassAdAspects(Type):tone:str=Context("toneofthemarketingcopy")product_features:list=Context("productfeaturestopromote")audience:str=Context("targetaudienceforthemessage")subject:str=Context("subjectortopicofthemessage")goal:str=Context("goalofthismarketingcampaignandmessage")classAdCopy(Type):title:str=Context("googleadtitletag")description:str=Context("googleaddescription")keywords:list=Context("keywordsforthesearchengine")

比特大陸支持的算力提供商BitFuFu向FTX提出1170萬美元的索賠:11月21日消息,比特大陸支持的數字資產算力服務提供商BitFuFu通過其子公司Ethereal Tech上周在Kroll登記,向加密交易所FTX提出近1170萬美元的索賠。

據此前報道,已破產的加密交易平臺FTX已在美國公司調查和風險咨詢公司Kroll的平臺上開啟債權人信息登記頁面,當前最大單筆索賠金額為ETHEREAL TECH PTE. LTD.登記的11,690,000美元。(福布斯)[2022/11/21 7:52:35]

然后就可以開始提問了:

語氣:大膽,但不傲慢

特色:亞洲醬料和香料、家常調料和套餐包,可以輕松在家烹飪。

aspects=AdAspects(tone="boldandbright,butnotarrogant",product_features=,audience="suburbanfamilies",subject="deliciousasianmealswithoutgoingtoarestaurant",goal="getsuburbanmomsanddadstotrybuytheirfirstomsompackorfreetastingkit")ad_copy=llm(input=aspects,output_type=AdCopy)print(f"Adcopy:{ad_copy}")模型輸出:

嘗試Omsom的美味亞洲醬料、香料、家常調料和套餐包。輕松為家人在家做出美味佳肴。

>title='DeliciousAsianMealsWithoutGoingtoaRestaurant|Omsom'description="TryOmsom'sdeliciousAsiansauces,aromatics,andhome-cookedseasoningsandmealpacks.Easilycookdeliciousmealsathomeforyourfamily."keywords=

ShapeShift將推出去中心化開源移動端應用程序:金色財經報道,非托管加密交易所和去中心化自治組織(DAO)ShapeShift通過將用戶遷移到一個新的開源應用程序,以進一步實現去中心化。

ShapeShift宣布,截至10月19日,其平臺的Web用戶均已遷移到該應用程序的去中心化版本。ShapeShift還宣布將推出提供DeFi體驗的新移動端App。新的移動端App在連接錢包和交易加密貨幣時,為用戶提供更多靈活性、移動性和功能。

Fox Foundation負責去中心化工作的Willy Orgorzaly表示,該移動端App是完全開源的,“唯一的后端是區塊鏈數據”,也將實現去中心化。(Cointelegraph)[2022/10/20 16:30:34]

如何創建自己的「ChatGPT」

基礎模型能理解一般的英語,但如果需要它們學習一些垂直語言和規則,prompt微調并不足夠,很多時候我們都需要構建自己的LLM。

利用用下面這個步驟,就能獲得像ChatGPT一樣遵循指令的LLM。

嘗試prompt-tuningChatGPT或其他模型

可以使用Lamini庫的API,在不同模型之間快速進行prompt-tuning,只需一行代碼,即可在OpenAI和開源模型之間切換。

Lamini庫已經優化了正確的prompt,這樣開發者就可以使用不同的模型,不必擔心如何為每個模型設置prompt的格式。

構建一個包含輸入-輸出對的大型數據集

這些數據集會向模型展示,它應該如何響應輸入,無論是遵循英文說明,還是以JSON響應。

研究者剛剛發布了一個只有幾行代碼的repo,使用Lamini庫,僅從100個數據點中,就能生成50k數據點。

而且因為使用Lamini庫來啟動Lamini引擎,所以這個過程根本不需要用到GPU。

在repo中,已經包含一個開源的70+k數據集。

項目地址:https://github.com/lamini-ai/lamini/

在大型數據集上微調基礎模型

除了數據生成器,研究者還發布了一個LLM,它使用Lamini對生成的數據進行了微調。以編程方式執行此操作的功能也會很快發布。

也可以把OpenAI的微調API作為起步。

在微調模型上進行RLHF

使用Lamini,就不再需要大型ML和人工標記團隊來運行RLHF。

部署到云端

只需點擊產品或功能中的API端點即可。

專為LLM打造的數據生成器

簡單來說,依照以下幾個步驟,就可以訓練自己的大語言模型了。

用于優化prompt微調和類型化輸出的Lamini庫。

用于微調和RLHF的高級Lamini庫,只需幾行代碼。

史上首個托管數據生成器,用于創建數據,來訓練遵循指令的LLM。注意,已獲得商業使用許可!

開源的指令跟隨LLM,使用上述工具,只需幾行代碼即可完成。

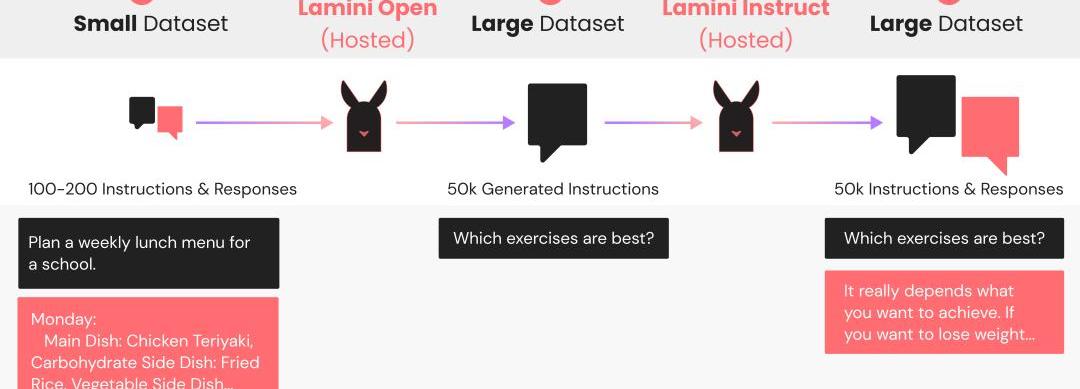

數據生成器工作原理

Lamini數據生成器是一個LLM管線,它采用原始的100多條指令的小集合,與預期的響應配對,生成50k+新的配對,靈感來自Stanford的Alpaca。這個生成管線使用Lamini庫來定義和調用LLM,以生成不同但相似的指令和響應對。

根據這些數據訓練后,你的LLM會遵循這些指示,因而得到改進。對于使用開源LLM的生成管線,研究者提供了一個很好的默認值,LaminiOpen和LaminiInstruct。

隨著每天新的LLM發布,研究者都會將默認值更新為性能最佳的模型。在目前的版本中,LaminiOpen用的是EleutherAI的Pythia,LaminiInstruct用的是Databricks的Dolly。

LaminiOpen會生成更多指令,而LaminiInstruct會生成這些指令的成對響應。

最終生成的數據集可供免費商業使用,已經通過CC-BY許可。

僅用一行代碼,就可以將Lamini庫的默認值換成其他開源或OpenAI模型。

研究者發現,OpenAI模型的平均表現更好,但它們的許可限制了將生成數據用于訓練類ChatGPT模型的商用。

對生成數據進行微調

在這個過程中,生成的數據會質量不一。

在微調之前,下一步就是將生成的數據過濾為高質量數據。

然后,Lamini會通過在這個過濾后生成的數據集上訓練基礎模型,來創建自定義LLM。

研究者已經發布了一個開源指令跟隨LLM,可以用Lamini來訓練Pythia基礎模型,生成的37k指令是從70k中篩選出來的。

顯然,Lamini庫的出現,讓迭代周期變得更快、更有效,有更多的人能夠構建模型,而不僅僅是試驗各種prompt。

團隊介紹

SharonZhou是Lamini的聯合創始人兼首席執行官。

個人主頁:https://sharonzhou.me/

她在哈佛大學獲得了計算機科學與古典文學聯合學士學位,并以最高榮譽獲得了碩士學位。

隨后,她在斯坦福大學獲得了計算機科學博士學位,師從吳恩達。

2022年,29歲的Zhou入選《麻省理工科技評論》「35歲以下科技創新35人」。

GregoryDiamos是MLPerf的聯合創始人。

他曾是百度硅谷AI實驗室的創始成員,對DeepSpeech和DeepVoice系統有貢獻。

參考資料:

https://lamini.ai/blog/introducing-lamini

Tags:MINIMINROMPROgemini求婚成功郭家毅gemini女友染染多大了MicroMoneyProsper

原文:Top?4?Directions?of?Bitcoin?Ecosystem?Scalability作者:kenyou由GweiResearch編譯 Ordinals?NFT?和?BRC-2.

1900/1/1 0:00:00背景 以太坊是目前最大和最活躍的區塊鏈平臺之一,它支持了數千個DApp和智能合約,涵蓋了金融、游戲、社交、藝術等各個領域。然而,以太坊也面臨著一些挑戰和局限,比如可擴展性、安全性、成本和效率等.

1900/1/1 0:00:00引言 盡管整體市場遇冷,但似乎Blur在NFTFi上向前躍進的腳步未曾放緩。根據其在5月2日所發布的推特動態,Blur正式從流動性聚合的直接交易層橫跨到借貸市場,接連推出了P2P永續借貸Blen.

1900/1/1 0:00:00Blur近日聯合Paradigm推出Blend這一P2PNFT借貸協議,以及基于此實現的貸款買NFT的功能.

1900/1/1 0:00:00金色財經報道,金融科技公司Block(SQ)在周四的股東信中表示,第一季度其CashApp部門的比特幣收入為21.6億美元,比第四季度的18.3億美元增長18%,比2022年第一季度增長25%.

1900/1/1 0:00:00原文來源于?Dappradar,白澤研究院編譯。因篇幅原因略有內容刪改,建議感興趣的讀者閱讀原文:隨著BoredApeYachtClub(BAYC)成立兩周年的臨近,現在正是回顧YugaLabs.

1900/1/1 0:00:00